负载均衡的工作原理是通过分散网络负载,提高系统的整体性能和可靠性。它根据当前的网络流量、服务器性能等条件,智能地将请求分配给最合适的服务器处理。负载均衡采用多种技术,如DNS负载均衡、特定服务软件的负载均衡策略以及硬件负载均衡等。其核心在于智能分配和调度,确保系统资源得到高效利用,提高访问速度,增强系统的可扩展性和稳定性。

本文目录导读:

随着互联网技术的飞速发展,网络负载均衡已成为确保高性能、高可用性服务的重要手段,负载均衡技术通过将网络中的负载分散到多个服务器或其他资源上,以提高系统的整体性能和可靠性,本文将详细介绍负载均衡的工作原理及其核心组件。

负载均衡概述

负载均衡技术旨在优化网络性能和服务质量,它通过分配和平衡网络负载,确保每台服务器都能得到适量的请求,从而避免单点过载,负载均衡可以应用于各种网络环境,如企业内网、云服务、数据中心等,其主要目标是最小化响应时间、最大化资源利用率和提高系统可靠性。

负载均衡的工作原理

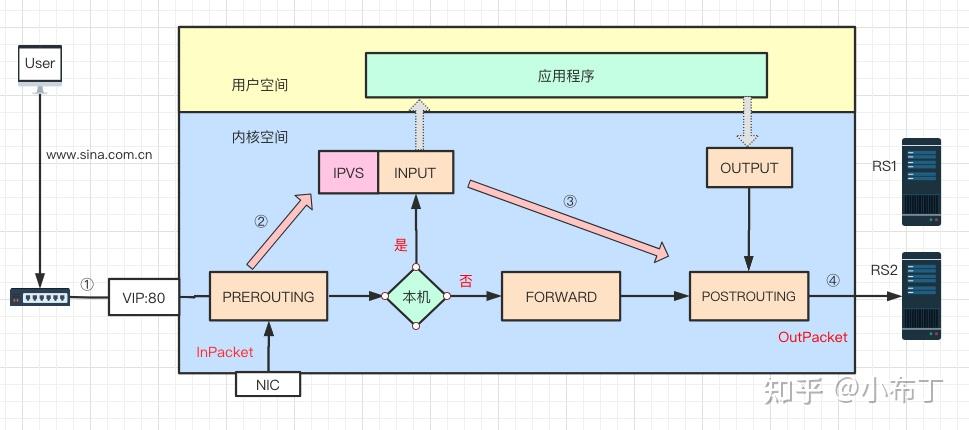

负载均衡的工作原理主要依赖于以下几个关键组件:

1、监控组件:负责实时监控网络状态和各服务器的负载情况,它通过收集性能数据(如CPU使用率、内存占用率、网络带宽等)来评估服务器的负载状况。

2、调度算法:根据收集到的性能数据,选择合适的调度算法来分配网络负载,调度算法可以根据服务器的性能、响应时间、可用性等指标进行决策,以确保负载分配的公平性和效率,常见的调度算法包括轮询、加权轮询、最少连接数等。

3、决策组件:基于监控组件提供的数据和调度算法,决策组件决定如何将请求分配给不同的服务器,它根据预设的策略(如负载均衡策略、容错策略等)进行决策,以确保系统的整体性能和可靠性。

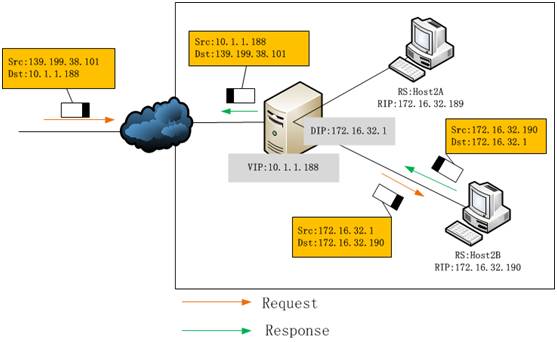

4、路由配置:根据决策组件的决策结果,对请求进行路由配置,确保请求被正确地发送到相应的服务器,这通常涉及到DNS配置、HTTP重定向等技术手段。

负载均衡的主要类型

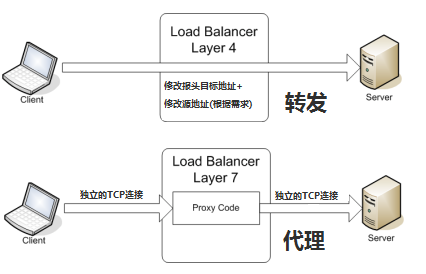

根据实现方式和应用场景的不同,负载均衡可分为以下几种类型:

1、DNS负载均衡:通过配置DNS服务器,将请求分散到多个IP地址上,这是最基础的负载均衡方式,适用于小型网络。

2、反向代理负载均衡:通过反向代理服务器接收请求,并根据配置或调度算法将请求转发给后端服务器,这种方式适用于大型网站和应用程序。

3、集群负载均衡:将多个服务器组织成集群,通过负载均衡器将请求在集群内部分配,这种方式可以提供高可扩展性和高可用性。

4、分布式缓存负载均衡:通过缓存技术将请求分散到多个服务器上,减轻单个服务器的负载压力,这种方式适用于读操作较多的场景。

负载均衡的应用场景

负载均衡广泛应用于各种网络环境和服务中,如云计算、数据中心、Web服务器集群等,通过负载均衡技术,可以确保网络服务的高性能和高可用性,提高系统的可靠性和扩展性,负载均衡还可以应用于大数据处理、分布式计算等领域,提高数据处理能力和效率。

负载均衡是一种重要的网络技术,它通过分散网络负载来提高系统性能和可靠性,负载均衡的工作原理主要依赖于监控组件、调度算法、决策组件和路由配置等关键组件,在实际应用中,应根据场景选择合适的负载均衡类型和技术手段,以实现最佳的网络性能和用户体验,随着云计算、大数据等技术的不断发展,负载均衡将在未来发挥更加重要的作用。

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号

还没有评论,来说两句吧...